Documentation Index

Fetch the complete documentation index at: https://docs.evo-ai.co/llms.txt

Use this file to discover all available pages before exploring further.

Visão Geral

O Agente LLM é o componente central do Evo AI, atuando como a parte “pensante” da sua aplicação. Ele aproveita o poder de um Large Language Model (LLM) para raciocínio, compreensão de linguagem natural, tomada de decisões, geração de respostas e interação com ferramentas. Diferentemente dos agentes de workflow determinísticos que seguem caminhos de execução predefinidos, o comportamento doAgente LLM é não-determinístico. Ele usa o LLM para interpretar instruções e contexto, decidindo dinamicamente como proceder, quais ferramentas usar (se houver) ou se deve transferir controle para outro agente.

Características Principais

Raciocínio Dinâmico

Uso de Ferramentas

Multi-turn

Flexibilidade

Criando seu Primeiro Agente LLM

Passo a Passo na Plataforma

Vamos criar um agente LLM completo usando a interface do Evo AI:1. Iniciar criação do agente

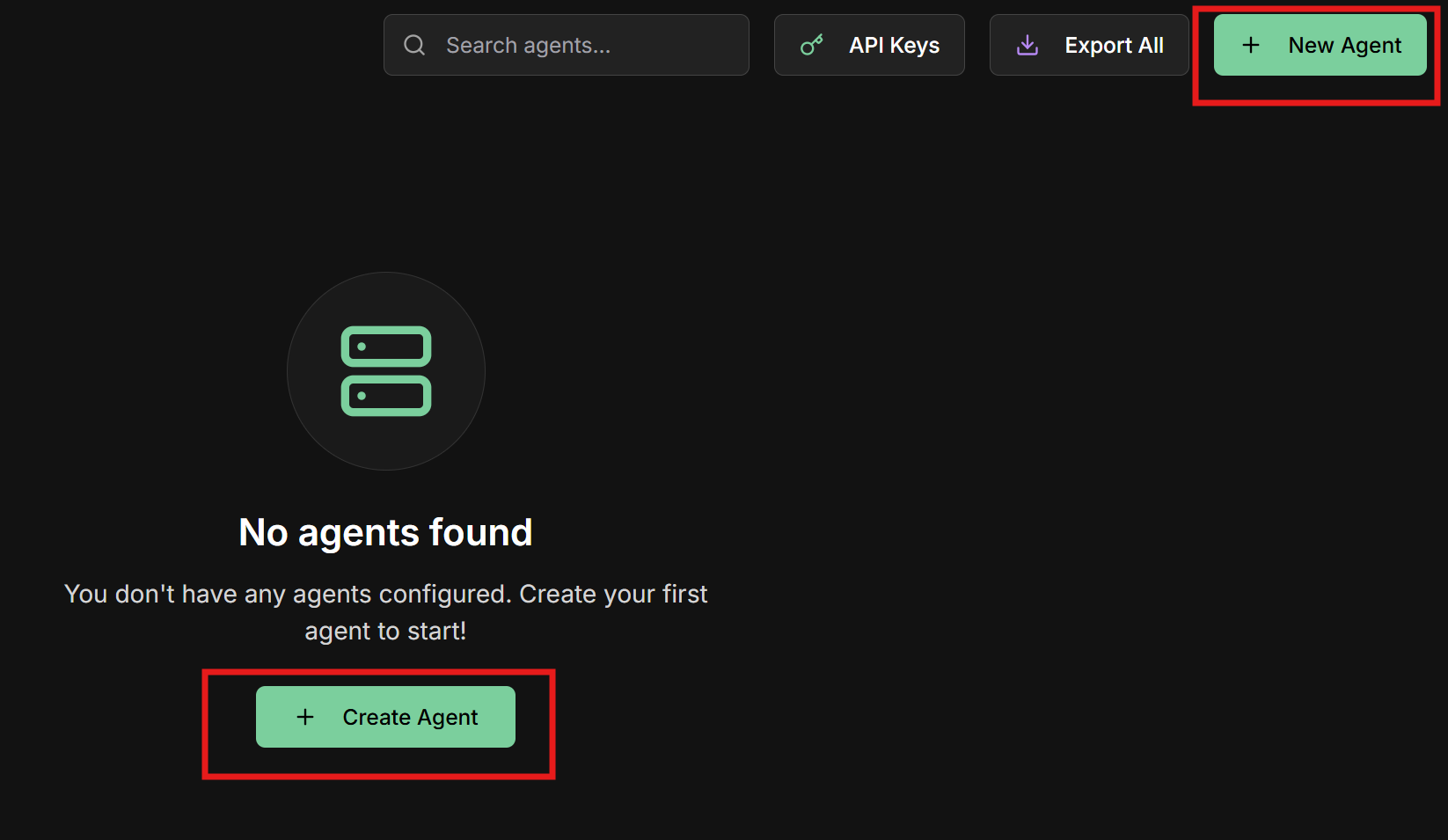

1. Iniciar criação do agente

- Na tela principal do Evo AI, clique em “New Agent”

- Você será direcionado para o formulário de criação

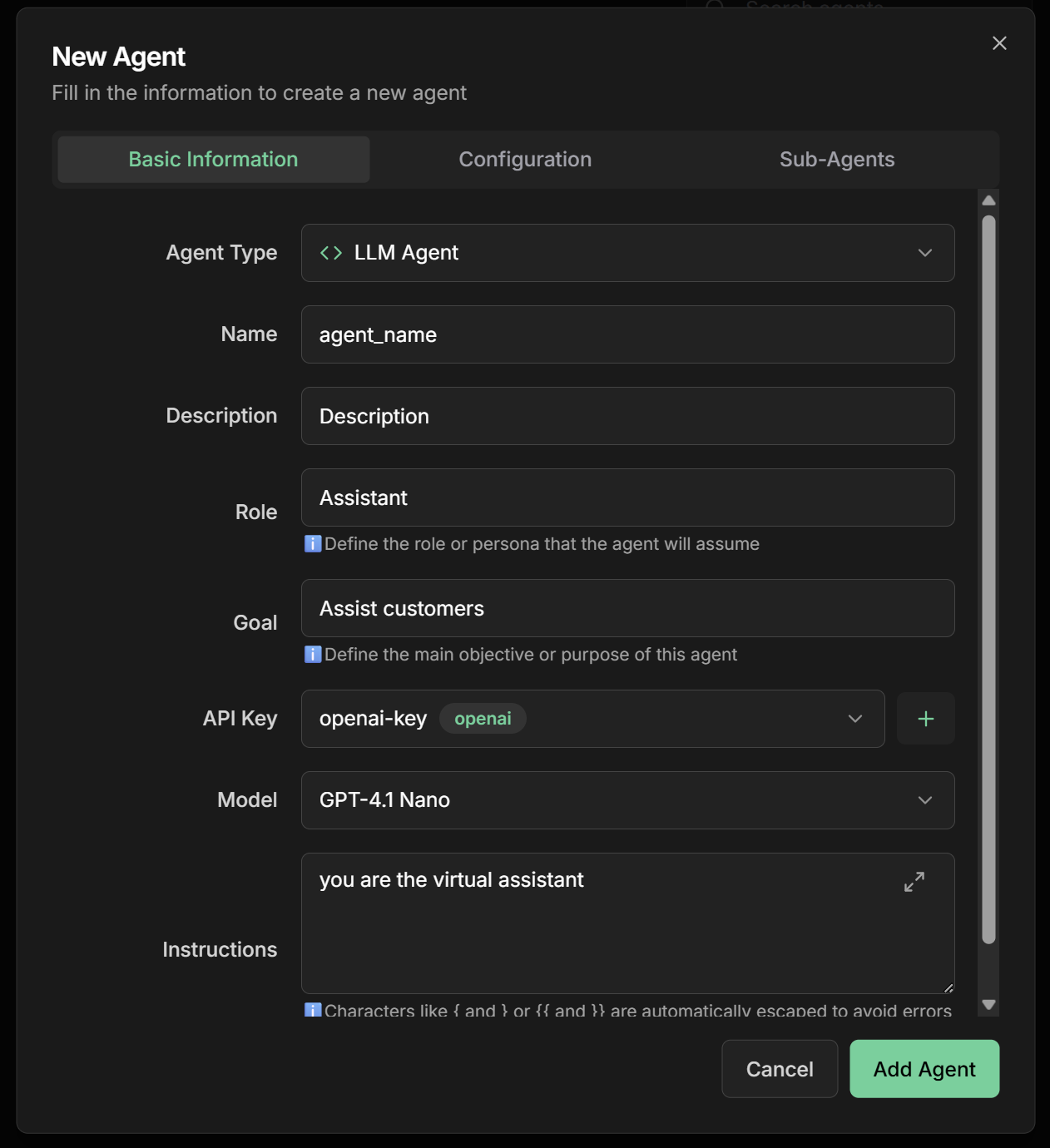

2. Configurar informações básicas

2. Configurar informações básicas

3. Selecionar modelo e API Key

3. Selecionar modelo e API Key

| Modelo | Características | Melhor para |

|---|---|---|

| GPT-4 | Raciocínio avançado, criativo | Tarefas complexas, análise |

| GPT-3.5-turbo | Rápido, econômico | Conversas gerais, suporte |

| Claude-3-Sonnet | Equilibrado, seguro | Análise de documentos |

| Gemini-Pro | Multimodal, rápido | Processamento de imagens |

| Llama2-70b | Open source, customizável | Casos específicos |

4. Definir instruções detalhadas

4. Definir instruções detalhadas

5. Configurar Agent Settings

5. Configurar Agent Settings

Agent Settings - Configure funcionalidades avançadas:Para nosso assistente de vendas, recomendamos:✅ Load Memory:- Ative para lembrar preferências dos clientes

- Permite personalização ao longo do tempo

- Melhora experiência de clientes recorrentes

- Não recomendado inicialmente (alto custo de tokens)

- Considere apenas para clientes VIP com histórico longo

- Ative para processos de vendas estruturados

- Ajuda a dividir tarefas complexas (análise + recomendação + fechamento)

- Melhora organização do atendimento

- Ative para acesso ao catálogo de produtos

- Configure tags:

produtos,tecnologia,precos - Permite respostas atualizadas sobre especificações

- Configure para capturar dados estruturados do cliente:

6. Salvar e ativar

6. Salvar e ativar

- Revise todas as configurações cuidadosamente

- Clique em “Save” ou “Criar Agente”

- Aguarde a confirmação de criação

- Seu agente estará disponível na lista de agentes

- Status deve aparecer como “Ativo”

Sistemas Multi-Agente (Sub-Agents)

Conceitos Fundamentais

Baseado no Google Agent Development Kit, sistemas multi-agente permitem criar aplicações complexas através da composição de múltiplos agentes especializados.transfer_to_agent é disponibilizada. Esta função permite que o agente principal delegue a execução da sessão para um dos seus sub-agentes especializados, transferindo o controle completo da conversa.Hierarquia de Agentes

Agentes de Workflow

Comunicação

Especialização

Configurando Sub-Agentes na Plataforma

1. Hierarquia de Agentes (Parent-Child)

1. Hierarquia de Agentes (Parent-Child)

- Crie os agentes especializados primeiro:

- Agente de cumprimentos

- Agente de qualificação

- Agente de demonstração

- Agente de fechamento

- Configure o agente coordenador:

- No formulário do agente principal

- Seção “Sub-Agents”

- Selecione os agentes criados anteriormente

- Defina a ordem de prioridade

- Defina as instruções de coordenação:

- Cada agente pode ter apenas um pai

- Configure hierarquia clara de responsabilidades

- Use nomes descritivos para facilitar referências

2. Exemplo Prático: Equipe de Vendas

2. Exemplo Prático: Equipe de Vendas

- Name:

lead_qualifier - Description:

Qualifica leads e identifica orçamento e necessidades - Instructions:

- Name:

product_demo - Description:

Demonstra produtos e explica benefícios técnicos - Instructions:

- Name:

closer - Description:

Especialista em fechamento e negociação - Instructions:

- Name:

sales_team_coordinator - Sub-Agents:

lead_qualifier,product_demo,closer - Instructions:

Mecanismos de Comunicação

Função transfer_to_agent

Função transfer_to_agent

- Disponibilizada automaticamente quando sub-agentes são configurados

- Permite transferir controle completo da sessão para um sub-agente específico

- O sub-agente assume a conversa e pode interagir diretamente com o usuário

- Contexto e histórico são mantidos durante a transferência

- Configure Sub-Agents no agente coordenador

- Use nas Instructions orientações claras sobre quando transferir

- Identifique por name o sub-agente de destino

- Especialização completa por área

- Reduz complexidade das instruções

- Melhora qualidade das respostas especializadas

- Facilita manutenção e atualizações

Estado Compartilhado

Estado Compartilhado

- Agentes compartilham informações via estado da sessão

- Dados persistem durante toda a conversa

- Permite continuidade entre diferentes agentes

- Output Key: Defina chave para salvar resultado

- Instructions: Use

{{user_input}}para input inicial e{{output_key}}para dados salvos - Context: Configure quais dados compartilhar

- Agente 1 salva:

customer_name,budget,preferences - Agente 2 usa: “Analise o pedido do usuário:

{{user_input}}e use dados do cliente:{{customer_data}}” - Agente 3 acessa: Histórico completo da conversa

Delegação Inteligente

Delegação Inteligente

- Agente coordenador analisa solicitação

- Decide automaticamente qual especialista acionar

- Transfere contexto completo para o agente escolhido

- Sub-Agents: Configure especialistas disponíveis

- Instructions: Defina critérios de roteamento

- Descriptions: Descreva bem cada especialista

Agentes como Ferramentas

Agentes como Ferramentas

- Um agente pode usar outro agente como ferramenta

- Permite especialização ainda maior

- Mantém responsabilidades bem definidas

- Tools: Adicione outros agentes como ferramentas

- Instructions: Explique quando usar cada agente-ferramenta

- Permissions: Configure acesso entre agentes

- Agente de vendas usa “calculadora de preços” (outro agente)

- Agente de suporte usa “consultor técnico” (especialista)

- Agente principal usa “validador de dados” (verificador)

Padrões Comuns de Multi-Agente

1. Padrão Coordenador/Dispatcher

Configuração na Plataforma

Configuração na Plataforma

- Agente Financeiro: Questões de faturamento e cobrança

- Agente Técnico: Suporte técnico e configurações

- Agente Comercial: Vendas e produtos

- Name:

customer_service_dispatcher - Sub-Agents: Adicionar todos os especialistas

- Instructions:

- Roteamento inteligente automático

- Especialização por área

- Escalabilidade fácil

2. Padrão Pipeline Sequencial

Configuração na Plataforma

Configuração na Plataforma

- Name:

data_enricher - Instructions: “Enriqueça dados do lead com informações públicas”

- Output Key:

enriched_data

- Name:

lead_scorer - Instructions: “Analise o pedido:

{{user_input}}e calcule score baseado em:{{enriched_data}}” - Output Key:

lead_score

- Name:

lead_classifier - Instructions: “Classifique como HOT/WARM/COLD baseado em:

{{lead_score}}” - Output Key:

lead_classification

- Name:

lead_router - Instructions: “Direcione para vendedor adequado:

{{lead_classification}}” - Output Key:

assignment_result

- Type: Sequential Agent

- Sub-Agents: Na ordem das etapas

- Instructions: Critérios de passagem entre etapas

3. Padrão Gerador-Crítico

Configuração na Plataforma

Configuração na Plataforma

- Name:

content_generator - Instructions:

- Output Key:

generated_content

- Name:

content_critic - Instructions:

- Output Key:

feedback

- Name:

content_refiner - Instructions:

- Output Key:

refined_content

- Type: Loop Agent

- Max Iterations: 3

- Sub-Agents: Gerador → Crítico → Refinador

- Stop Condition: Score > 8 ou máximo de iterações

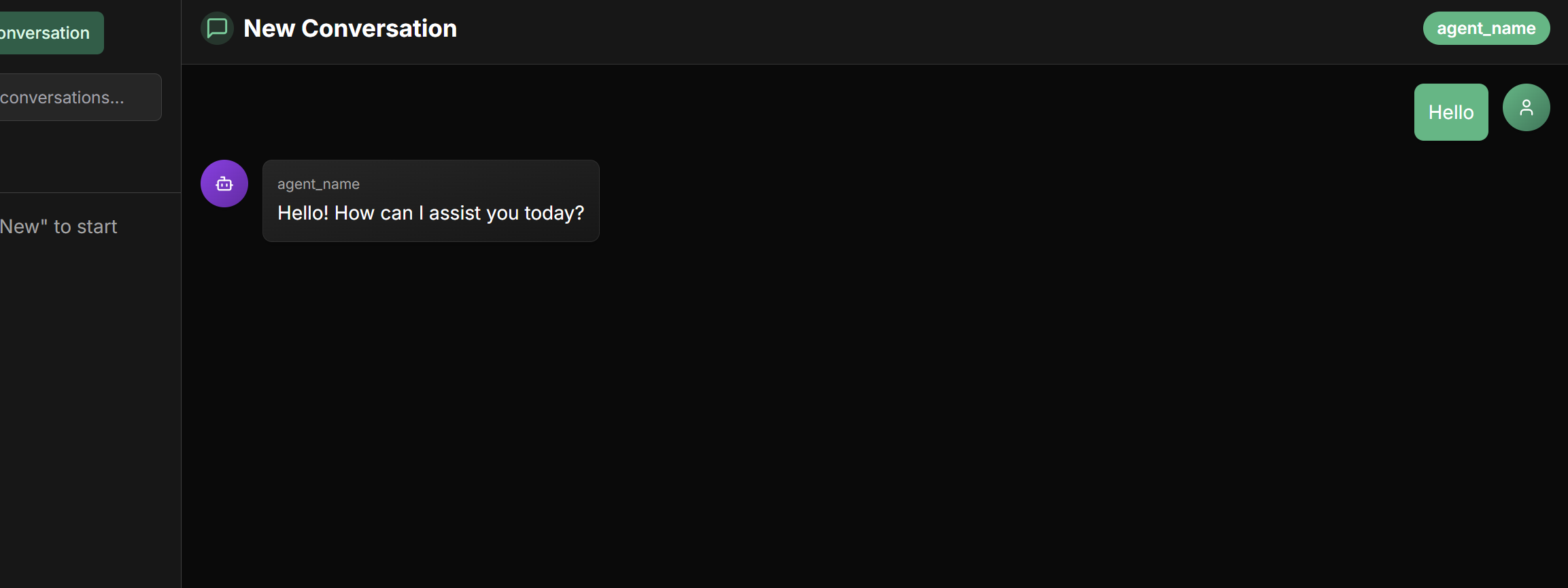

Testando seu Agente

Primeira Conversa

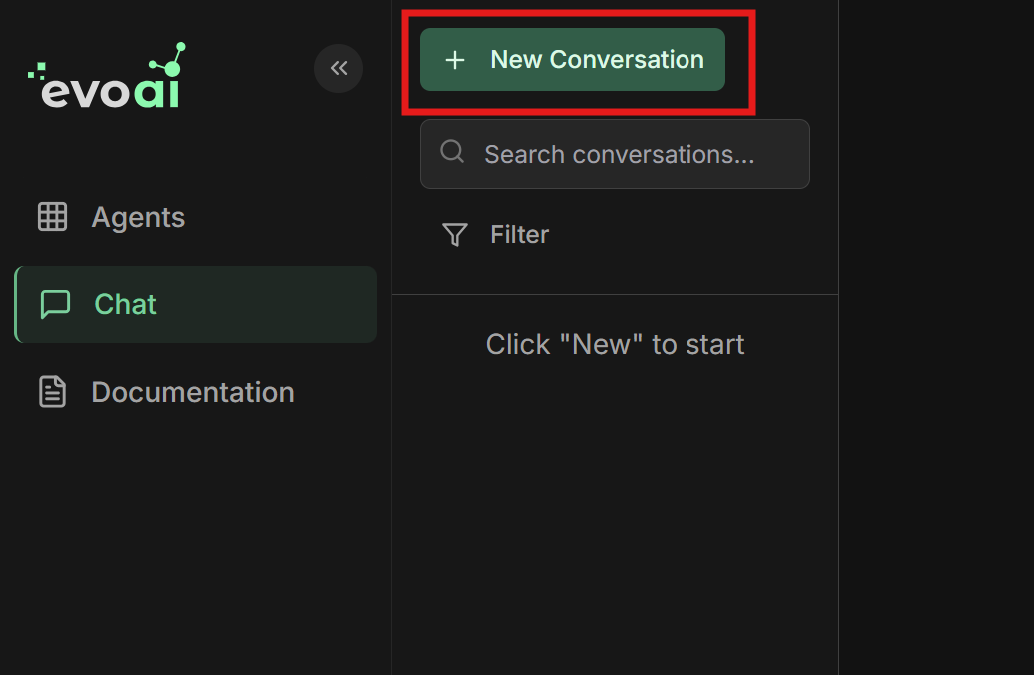

Acessar interface de chat

Acessar interface de chat

- Vá para a tela de chat no menu principal

- Clique em “New Chat” para iniciar uma nova conversa

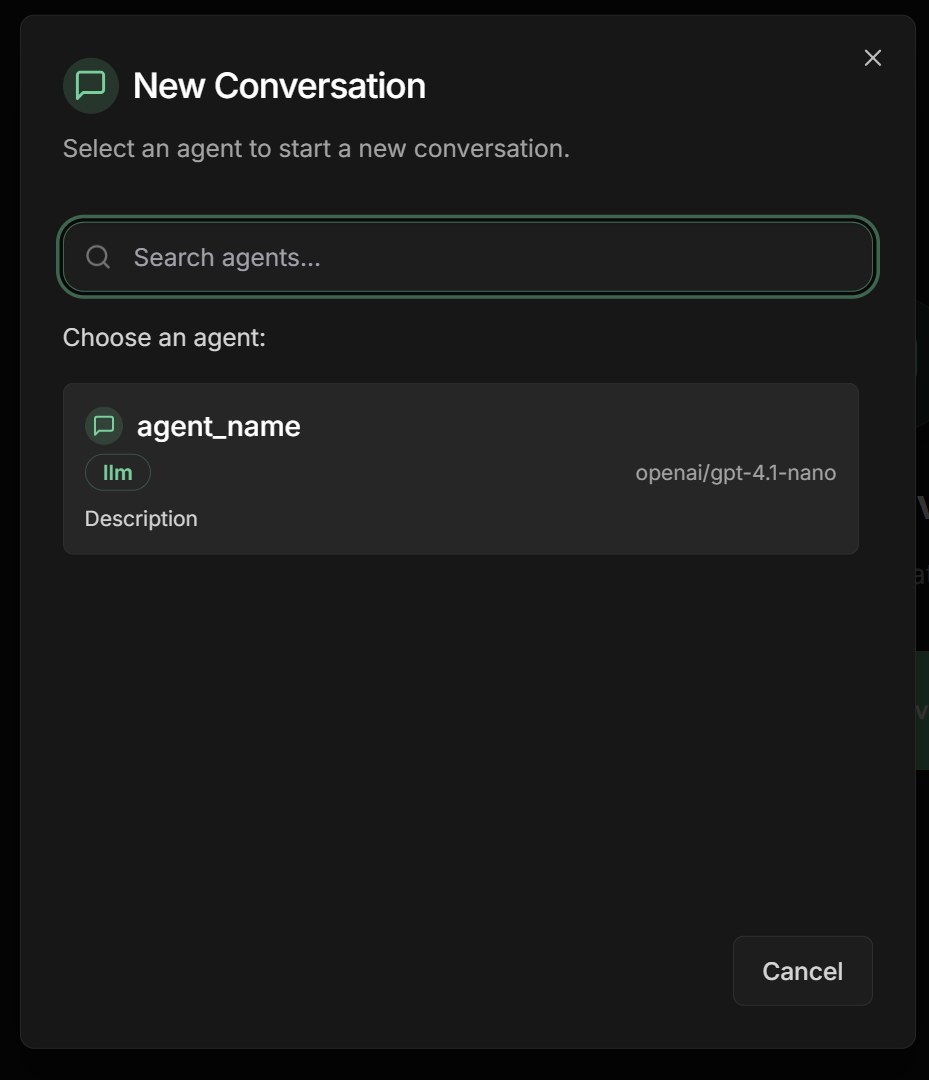

Selecionar o agente

Selecionar o agente

- Selecione o agente que você acabou de criar

- A interface de chat será carregada com o agente escolhido

Testar cenários diversos

Testar cenários diversos

Avaliar performance

Avaliar performance

- Ajuste as instruções na interface

- Adicione exemplos específicos

- Refine o tom de voz

- Teste novamente

Componentes Essenciais na Interface

1. Identidade e Propósito

Nome (Obrigatório)

Nome (Obrigatório)

Name na interface:- Identificador único do agente

- Usado para referências internas e comunicação entre agentes

- Deve ser descritivo e refletir a função do agente

- Evite nomes reservados como

user

assistente_vendassuporte_tecnicoanalista_financeiro

Descrição (Recomendado)

Descrição (Recomendado)

Description na interface:- Resumo conciso das capacidades do agente

- Usado por outros agentes para determinar roteamento de tarefas

- Deve ser específico o suficiente para diferenciá-lo de outros agentes

- “Especialista em consultas sobre faturas e cobranças atuais”

- “Analisa dados financeiros e gera relatórios de performance”

- “Resolve problemas técnicos de conectividade e configuração”

Modelo (Obrigatório)

Modelo (Obrigatório)

Model na interface:- Especifica o LLM que alimentará o raciocínio do agente

- Impacta capacidades, custo e performance

- Selecione da lista de modelos disponíveis

gpt-4- Raciocínio avançadoclaude-3-sonnet- Equilibrado e segurogemini-2.0-flash- Rápido e multimodal

2. Instruções (Instructions)

Elementos essenciais

Elementos essenciais

Instructions na interface:- Tarefa principal ou objetivo

- Personalidade ou persona

- Restrições comportamentais

- Formato de saída desejado

- Processo passo a passo

Dicas para instruções eficazes

Dicas para instruções eficazes

- Seja claro e específico: Evite ambiguidades

- Use Markdown: Melhore a legibilidade com cabeçalhos, listas

- Forneça exemplos: Para tarefas complexas

- Defina tom de voz: Profissional, amigável, técnico

Variáveis dinâmicas e compartilhamento de estado

Variáveis dinâmicas e compartilhamento de estado

{{var}} para inserir valores dinâmicos nas instruções do agente:Variáveis automáticas disponíveis:{{user_input}}- A mensagem completa do usuário que iniciou a conversa{{output_key_name}}- Resultado salvo por outros agentes (onde output_key_name é o nome da chave configurada)

- Quando um agente tem um Output Key configurado, sua resposta é automaticamente salva no estado compartilhado

- Outros agentes podem usar essa informação nas suas instruções através de placeholders

- O estado persiste durante toda a conversa ou workflow

- Permite que agentes trabalhem em conjunto, cada um contribuindo com sua especialidade

- É especialmente útil em workflows sequenciais, loops e sistemas multi-agente

{{analise_cliente}}, agora faça uma recomendação personalizada.”3. Configurações Avançadas

Agent Settings

Agent Settings

Agent Settings na interface:Load Memory:- Quando ativado, o agente carregará e usará sua memória de longo prazo

- Mantém contexto e informações aprendidas nas sessões anteriores

- Permite continuidade e personalização ao longo do tempo

- Útil para agentes que precisam “lembrar” preferências do usuário

- Carrega automaticamente o histórico de conversas ao iniciar nova sessão

- Fornece acesso imediato às interações e conhecimentos anteriores

- ⚠️ Aviso de consumo: Aumenta significativamente o uso de tokens

- Monitore custos da API ao usar este recurso

- Recomendado apenas para sessões que realmente precisam do contexto completo

- Ativa recursos avançados de planejamento para tarefas complexas

- O agente divide automaticamente tarefas grandes em etapas menores

- Melhora a organização e execução de processos multi-etapas

- Ideal para agentes que lidam com workflows complexos

- Habilita acesso à base de conhecimento da organização

- Adiciona automaticamente uma ferramenta de busca no conhecimento

- Filtro de Tags: Seleciona documentos específicos por tags

- Se nenhuma tag for especificada, usa todos os documentos disponíveis

- Melhora qualidade das respostas com informações organizacionais

- Define estrutura específica para as respostas do agente

- Garante formato consistente e padronizado de saídas

- Configura campos com nome, tipo e descrição

- Tipos disponíveis: string, number, boolean, array, object

- Útil para integrações e processamento automático de respostas

Parâmetros de Geração

Parâmetros de Geração

Advanced Settings na interface:Temperature (0.0 - 1.0):0.0: Respostas determinísticas0.7: Balanceado (recomendado)1.0: Máxima criatividade

- Limite de tokens na resposta

- Controla tamanho da resposta

- Considere custo vs. completude

0.1: Respostas focadas0.9: Mais diversidade

Output Key - Compartilhamento de Estado

Output Key - Compartilhamento de Estado

Output Key na interface:O Output Key permite que o agente LLM salve sua resposta em uma variável específica no estado compartilhado, tornando o resultado disponível para outros agentes ou iterações futuras.Como funciona:- Configure o campo

Output Keycom um nome descritivo - A resposta do agente será salva automaticamente nessa variável

- Outros agentes podem acessar usando placeholders

{{output_key_name}} - Funciona em workflows, loops e sistemas multi-agente

- Quando um agente LLM é usado dentro de um Loop Agent, o sistema automaticamente adiciona a ferramenta

exit_loop - O agente pode usar essa ferramenta para sinalizar quando o loop deve parar

- Isso é útil para processos iterativos como refinamento de conteúdo ou análise até atingir qualidade desejada

- Use snake_case:

resultado_analise,dados_processados - Seja descritivo:

feedback_qualidadeem vez defeedback - Evite conflitos com variáveis existentes no estado

- Documente o formato esperado nas instruções

- Em loops, instrua claramente quando o agente deve usar

exit_loop

Casos de Uso Comuns

Atendimento ao Cliente

- Model: GPT-3.5-turbo (rápido)

- Temperature: 0.3 (consistente)

- Sub-agents: Especialistas por área

- Tools: Base de conhecimento

- Agent Settings:

- Load Memory: ✅ (lembrar preferências)

- Load Knowledge: ✅ (FAQ e políticas)

- Output Schema: ✅ (tickets estruturados)

Assistente de Vendas

- Model: GPT-4 (raciocínio avançado)

- Temperature: 0.7 (criativo)

- Sub-agents: Qualificador, demonstrador

- Tools: Catálogo de produtos

- Agent Settings:

- Load Memory: ✅ (histórico cliente)

- Planner: ✅ (processo vendas)

- Output Schema: ✅ (dados estruturados)

Análise de Dados

- Model: Claude-3-Sonnet (analítico)

- Temperature: 0.2 (preciso)

- Sub-agents: Coletores de dados

- Tools: APIs de dados

- Agent Settings:

- Planner: ✅ (análises complexas)

- Output Schema: ✅ (relatórios padronizados)

- Load Knowledge: ✅ (metodologias)

Assistente Pessoal

- Model: Gemini-Pro (multimodal)

- Temperature: 0.5 (equilibrado)

- Sub-agents: Agenda, tarefas

- Tools: Calendário, email

- Agent Settings:

- Load Memory: ✅ (preferências pessoais)

- Preload Memory: ✅ (contexto completo)

- Planner: ✅ (organização tarefas)

Melhores Práticas

Definição clara de objetivos

Definição clara de objetivos

- Seja específico no campo Description

- Defina limites claros nas Instructions

- Estabeleça critérios mensuráveis no Goal

- Documente casos de uso no campo Notes

Otimização de conversas

Otimização de conversas

- Use Output Keys para rastrear progresso

- Configure Sub-Agents para especialização

- Implemente fallbacks nas instruções

- Monitore performance via logs

Agent Settings - Boas Práticas

Agent Settings - Boas Práticas

- ✅ Use para agentes de atendimento personalizado

- ✅ Ative para assistentes que precisam lembrar preferências

- ❌ Evite para agentes que processam dados sensíveis

- ❌ Não use se a privacidade for crítica

- ✅ Ideal para continuação de sessões complexas

- ⚠️ Cuidado: Monitore custos - aumenta uso de tokens significativamente

- ✅ Use apenas quando contexto histórico for essencial

- ❌ Evite para agentes de alta frequência/baixo contexto

- ✅ Essencial para tarefas multi-etapas complexas

- ✅ Use em agentes de análise e relatórios

- ✅ Ideal para workflows de vendas estruturados

- ❌ Desnecessário para respostas simples/diretas

- ✅ Configure tags específicas para filtrar conhecimento relevante

- ✅ Use para agentes que precisam de informações organizacionais

- ✅ Combine com instruções claras sobre quando buscar conhecimento

- ❌ Sem tags pode tornar respostas lentas em bases grandes

- ✅ Essencial para integrações com outros sistemas

- ✅ Use para padronizar dados estruturados

- ✅ Defina descrições claras para cada campo

- ✅ Teste o schema antes de usar em produção

- ❌ Não use para conversas naturais simples

Segurança e confiabilidade

Segurança e confiabilidade

- Valide entradas nas instruções

- Limite escopo de cada agente

- Configure rate limiting se disponível

- Monitore custos via dashboard

- ⚠️ Atenção especial: Preload Memory aumenta custos significativamente

- Gerencie acesso à base de conhecimento via tags apropriadas

Próximos Passos

Agentes de Workflow

Configurações Avançadas

Protocolo A2A

Ferramentas Personalizadas

Os agentes LLM são a base para criar experiências de IA verdadeiramente inteligentes e adaptáveis. Com a configuração adequada via interface da plataforma, você pode construir assistentes poderosos que atendem às necessidades específicas do seu negócio.